IA

Synthesia y ElevenLabs son plataformas que permiten copiar la forma de hablar de una persona.

PorJuan Ríos

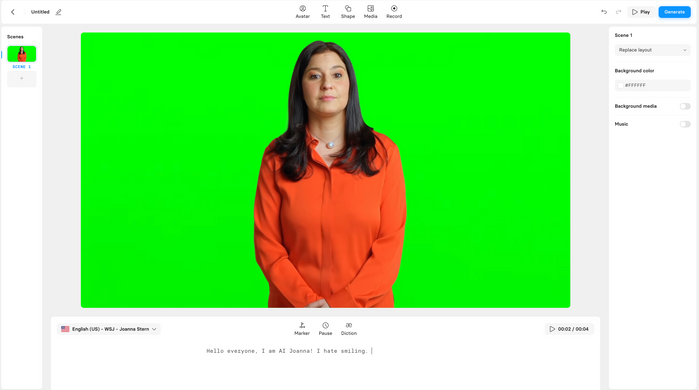

La periodista Joanna Stern clonó su voz e imagen para crear contenido a través de texto. (Freepik)

La periodista Joanna Stern clonó su voz e imagen para crear contenido a través de texto. (Freepik)

La brecha entre la realidad y lo digital se hace cada vez más delgada. La inteligencia artificial se ha encargado de hacer más estrecha esa diferencia y un experimento de The Wall Street Journal demostró que es posible clonar la voz y la imagen de una persona para engañar a los demás.

La periodista, Joanna Stern, fue la encargada de hacer estas pruebas usando dos herramientas: Synthesia para la generación de videos con su imagen y forma de hablar, como también, ElevenLabs para crear archivos de audio que replicarán su voz.

WhatsApp, Facebook e Instagram tendrán más inteligencia artificial

Con estos contenidos pudo pasar las verificaciones de voz de su banco, engañar al directivo de una compañía para pedirla una entrevista y confundir a su familia en llamadas y videollamadas.

Si bien los resultados aún necesitan de mucha más precisión y en ocasiones es evidente que hay una IA detrás del contenido, está claro que el crecimiento de esta tecnología abre las puertas a varios retos para las compañías, las autoridades y la sociedad.

Cómo clonaron la voz y la imagen

Toda inteligencia artificial necesita información para entrenarse y generar un contenido. Esa es la base de su funcionamiento y en este caso Joanna Stern, fue quien proporcionó los datos a las dos plataformas para obtener los resultados y engañar a sus familiares.

Con Synthesia, una herramienta que crea avatares a partir de video y audio grabados, algo que también se conoce como deepfakes, la periodista logró alimenetar con 30 minutos de video y casi dos horas de audios la IA para obtener su avatar.

Esta plataforma permite mantener y crear un avatar personalizado por 1.000 dólares al año, además de una tarifa de suscripción mensual, aunque ofrece personajes de stock a un costo más bajo.

La periodista Joanna Stern clonó su voz e imagen para crear contenido a través de texto.

La periodista Joanna Stern clonó su voz e imagen para crear contenido a través de texto.

Usando esta tecnología crearon un video en TikTok para ver el alcance de la IA. Escribieron las instrucciones en texto para asegurarse de lo que iba a decir el avatar y el resultado fue satisfactorio.

Si bien en la red social se dieron cuenta de que no era una persona real por sus pocas expresiones faciales y gestos con las manos, la conclusión del experimento fue que para oraciones largas el avatar puede ser “convincente”.

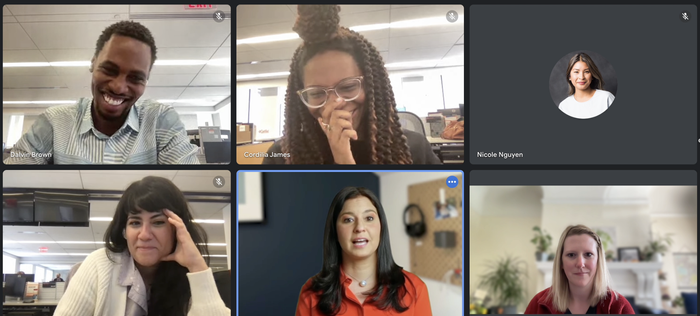

Luego, hicieron algo similar en una videollamada con la familia de Joanna Stern, pero “la postura perfecta y la falta de ingenio” dieron señales a sus conocidos para que detectaran que no se trataba de ella, aunque logró confundirlos al inicio.

Para crear el clon de la voz, a ElevenLabs lo alimentaron con 90 minutos de archivos de voz y luego de dos minutos quedó el entrenamiento para pedirle un audio con el tono de la periodista tras darle una instrucción en texto.

Usar esta plataforma tiene un costo de 5 dólares al mes y a diferencia del trabajo que hace Synthesia con la voz, aseguran que suena “mucho más humano, con mejores entonaciones y fluidez”.

Te puede interesar: El rol de las nuevas tecnologías en la gestión del talento

La periodista Joanna Stern clonó su voz e imagen para crear contenido a través de texto.

La periodista Joanna Stern clonó su voz e imagen para crear contenido a través de texto.

Con esta tecnología hicieron dos experimentos. Por un lado, Stern llamó a su hermana, quien le dijo que sonaba igual a ella, pero que se dio cuenta de que no era real porque no respiraba al hablar.

Luego llamó a su banco, que le pidió verificación con voz para que dijera su nombre y datos personales y pasó ambas pruebas sin problemas, engañando al sistema biométrico.

Todo este panorama genera muchas alertas.

Por un lado, una persona que tiene un perfil público puede ser suplantada con facilidad porque cualquier puede tomar su contenido de internet y entrar una inteligencia artificial. Por eso, tanto ElevenLabs como Synthesia aseguran que están trabajando en procesos de verificación adicional para no tener estos problemas.

Pero para Stern este tipo de herramientas terminan siendo un beneficio. “Mi clon de video carecía de las cosas que me hacen ser yo. Pero también, planeo usar estas herramientas para tener más tiempo para ser un ser humano real”, escribió la periodista.

INFOBAE

COMMENTS